In concomitanza con la progressiva entrata in vigore delle disposizioni dell’AI Act, gli operatori sono tenuti a rispettare un insieme di obblighi volti a garantire la trasparenza, la sicurezza e il controllo umano sull’uso dei sistemi di intelligenza artificiale.

Requisiti ribaditi altresì nelle nuova Legge sull’Intelligenza artificiale, in via di definitiva approvazione da parte del Parlamento italiano, le cui disposizioni andranno interpretate e applicate conformemente all’AI Act.

Gli operatori, in particolare, sono tenuti a garantire, per il tramite delle necessarie misure di governance, delle opportune modifiche alle policy aziendali, nonché di apposite clausole nei contratti di fornitura, che i requisiti normativi imposti dall’AI Act vengano rispettati non solo dai fornitori di tali sistemi, ma altresì dall’ente stesso, quando li utilizza.

Ciò presuppone un corretto risk assessment da parte dell’ente, che individui i diversi profili di rischio correlati all’utilizzo dei diversi sistemi di IA.

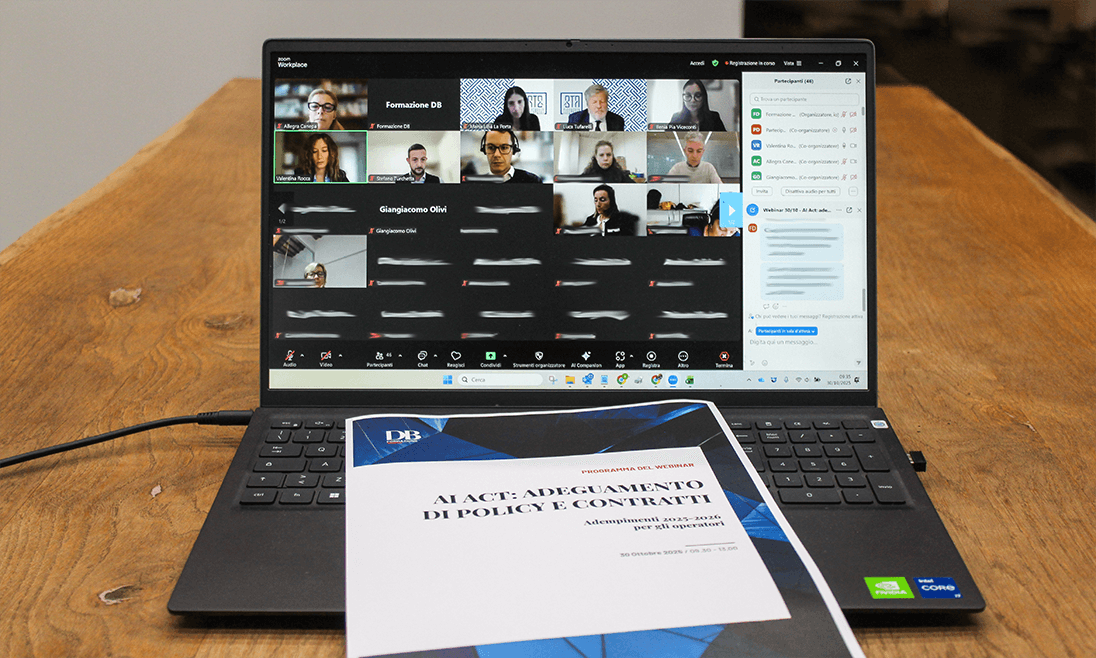

Il corso, dopo essersi soffermato sulla timeline applicativa delle disposizioni dell’AI Act e sul contesto normativo e regolamentare in via di definizione, approfondirà i presidi necessari per un’adeguata gestione del rischio, ponendo attenzione in particolare al rispetto dei requisiti per l’uso dei sistemi di IA, nelle politiche e nei processi dell’ente.